Ollama和llama.cpp什么关系,或者说有关系吗? - 知乎

它基于llama.cpp实现,本地CPU推理效率非常高(当然如果有GPU的话,推理效率会更高), 还可以兼容 openai的接口。 本文将按照如下顺序介绍Ollama的使用方法~

草泥马是alpaca还是llama,两者的区别主要是什么? - 知乎

Lama glama(拉丁学名)=llama(西班牙语通用名),主要被印加人当驴子当驮兽,毛比较粗不怎么有价值,用来做毛毡;肉可以吃。现在白人又找到一个新的用途——当畜群守卫,这种生 …

LM-studio模型加载失败? - 知乎

cuda llama.cpp v1.17.1版本有问题,删除后,用v1.15.3就可以了,升级后报错

为什么ollama运行不调用gpu? - 知乎

我电脑配置i7-11800H,ram 40G,3060 6G laptop显卡,想本地运行一下deepseek,遇到类似问题,即ollama运行deepseek 7b,8b尚可,而14b模型时候逐词输出太慢,而且只有CPU工 …

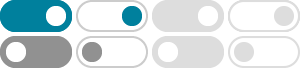

为什么都在用ollama而lm studio却更少人使用? - 知乎

还有一点,ollama是llama.cpp实现模型推理,模型小,速度快。 4. 还有,ollama提供11434端口的web服务,重要的是还兼容openai的端点接口,可以和各种前端配合,比如ollama自己open …

llama.cpp里面的Q8_0,Q6_K_M,Q4_K_M量化原理是什么? - 知乎

llama.cpp:一个高效的机器学习推理库,其中实现了很多量化方法。 他的作者 @ggerganov 不喜欢写论文和教程文档,导致这个库的学习资料非常少,很多时候只能看代码。

大模型推理框架,SGLang和vLLM有哪些区别? - 知乎

文章中的TODO有待补充,第一次认真写知乎,有任何问题欢迎大家在评论区指出. 官方vllm和sglang均已支持deepseek最新系列模型(V3,R),对于已经支持vllm和sglang的特定硬件( …

本地Dify为什么无法添加Ollama? - 知乎

混合部署:无缝集成本地模型(如Ollama部署的Llama 3) 下载docker. 我这里用的官网下载最新docker desktop客户端,直接下载即可。 选择合适自己机子的版本,我这里选择这个:

Deekseek r1本地部署,14b和32b最小需要多大显存吗? - 知乎

如题,本地部署的话,14b的用16g显存显卡能用gpu跑吗,32b的用32g显存显卡能用gpu跑吗?

Meta 发布模型 Llama 3,实际体验效果如何? - 知乎

Llama 3 70B 到底好不好用呢? 我第一时间就做了测试。 顺便说一下,目前能够使用 Llama 3 70B 对话的地方很多,包括但不限于 Meta 官方的 meta.ai,Huggingface 的 …